召回率、准确率

在二分类问题中,常用的分类器性能评价指标是精确率和召回率

如图所示:

绿色的半圆就是TP(True Positives)

红色的半圆就是FP(False Positives)

左边的灰色长方形(不包括绿色半圆),就是FN(False Negatives)

右边的 浅灰色长方形(不包括红色半圆),就是TN(True Negatives)

这个绿色和红色组成的圆内代表我们分类得到模型结果认为是正值的样本。

混淆矩阵:

| 预测 | |||

| 正 | 负 | ||

| 实 际 |

正 | TP,真正类(True Postive) | FN,假负类(False Negative) |

| 负 | FP,假正类(False Postive) | TN,真负类(True Negative) | |

精确率: $P = \frac{TP}{TP + FP}$

召回率: $R = \frac{TP}{TP + FN}$

精确率和召回率的调和均值: $\frac{2}{F_1}=\frac{1}{P}+\frac{1}{R}$ ,即 $F_1 = \frac{2TP}{2TP+FP+FN}$ 。

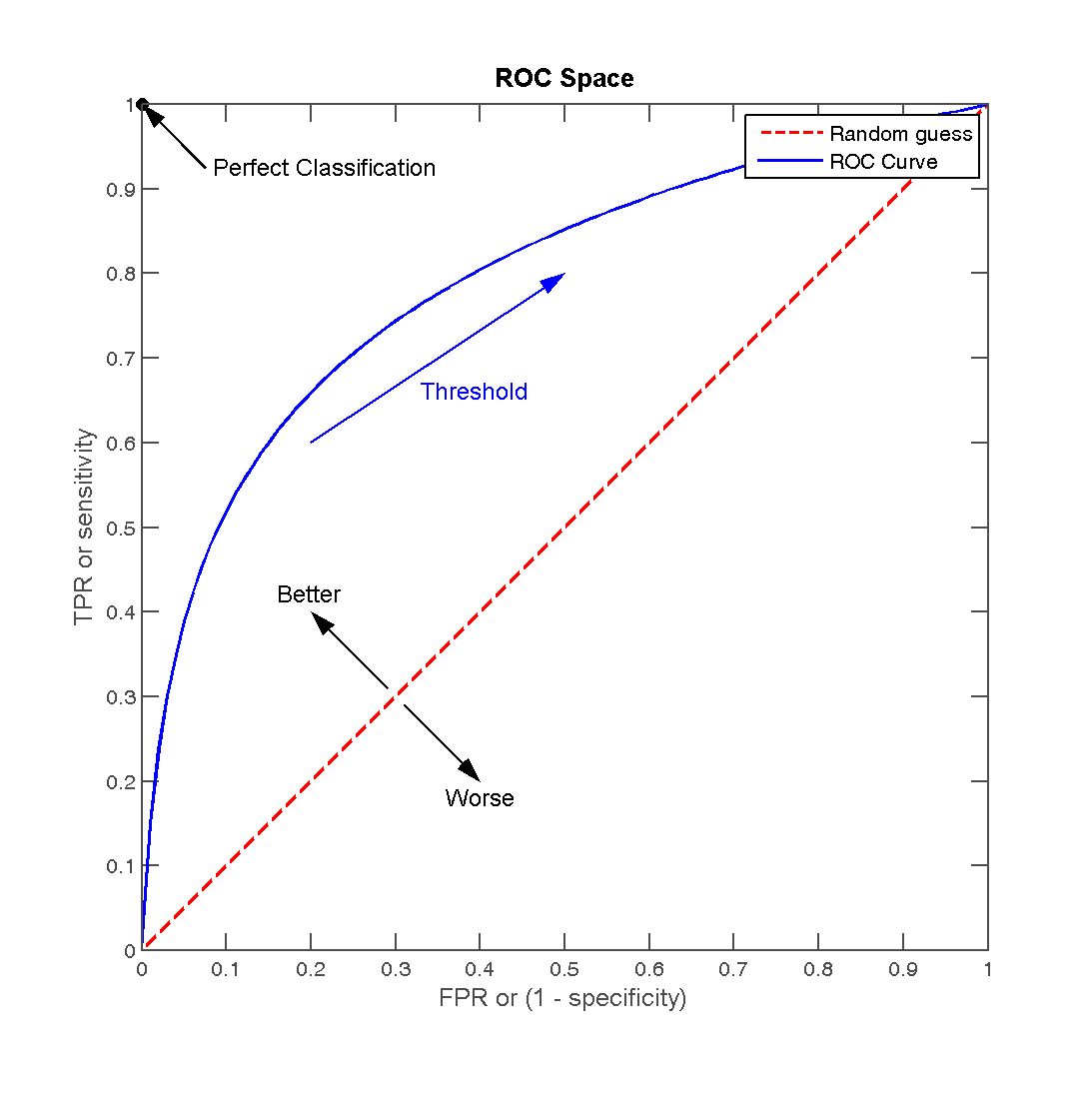

RoC曲线、AUC值

纵坐标—>灵敏度(true positive rate ):$TPR=\frac{TP}{TP+FN}$,预测的正类中实际正实例占所有正实例的比例

横坐标—>特异度(false positive rate):$FPR=\frac{FP}{FP+TN}$,预测的正类中实际负实例占所有负实例的比例

曲线下方的面积,就是模型准确率的度量。

TPR越大,预测正类中实际正类越多;FPR越大,预测正类中实际负类越多。

TPR越高,FPR越小,我们的模型和算法就越高效。也就是画出来的RoC曲线越靠近左上越好。

AUC(Area Under Curve)值:Roc曲线下的面积,介于0.1和1之间。

AUC作为数值可以直观的评价分类器的好坏,值越大越好。

AUC值是一个概率值,当随机挑选一个正样本以及负样本,当前的分类算法根据计算得到的Score值将这个正样本排在负样本前面的概率就是AUC值,AUC值越大,当前分类算法越有可能将正样本排在负样本前面,从而能够更好地分类。

ROC曲线有个很好的特性:当测试集中的正负样本的分布变换的时候,ROC曲线能够保持不变。

P-R曲线

即 “精确率precision“ vs “召回率recall 曲线”

纵坐标—>精确率$P$

横坐标—>召回率$R$

精确率越高,召回率越高,我们的模型和算法就越高效。也就是画出来的PR曲线越靠近右上越好。